|

筆者在使用過gemini 3 模型後,什麼都沒做好,token飛快的就把預算燒玩了 於是研究起本地端架vLLM,以下是說明

OpenClaw如何切換到本機模型?如果希望在執行自動化任務時保持流暢、不出現卡頓,同時避免頻繁觸發上下文長度限制,那麼選擇合適的開源模型就非常關鍵。 對OpenClaw來說,模型不僅需要具備良好的推理能力和語言理解能力,還需要有穩定的工具呼叫( Tool Calling)能力。因為在自動化任務中,模型需要頻繁地呼叫各種工具完成操作,因此工具呼叫能力往往是選擇模型時最重要的指標之一。

WSL2,UBUNTU,openclaw,本機模型,vLLM

很多人第一次嘗試本地部署模型時,往往會選擇Ollama 。它的優點確實很明顯:安裝簡單、設定方便,幾乎可以做到「傻瓜式」部署。

但在OpenClaw這種自動化任務場景下,Ollama的呼叫方式和推理速度並不理想。實際使用往往會遇到兩個問題: 在連續運行多個任務後,經常會出現上下文不夠用的情況。 因此,如果你希望獲得更穩定、更有效率的本地部署體驗,你需要選擇更合適的推理框架。 一般來說: 遠端叢集/多Agent場景:建議使用SGLang 單卡本地部署:強烈建議vLLM

目前來看,vLLM可以說是單機部署OpenClaw的最佳解決方案之一。

在開始之前,建議大家安裝下Windows Terminal,它是一款新式、快速、高效、強大且高效的Windows 的終端程序,適用於命令列工具和命令提示符,PowerShell和WSL 等Shell 用戶。可以方便我們切換不同的系統!

環境: WIN 11 + POWER SHELL + WSL2

在PowerShell(管理員)執行:

安裝Ubuntu, -d 指定img 是 Ubuntu

檢查版本:

確保輸出結果是: WSL2

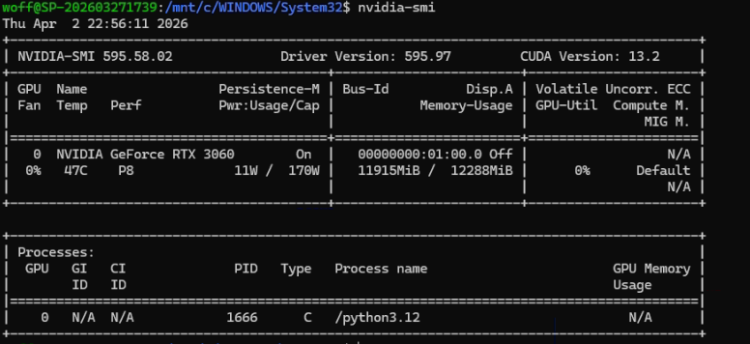

二、WSL 安裝CUDA 驅動支援先確認Windows已安裝NVIDIA驅動程式。 我的是RTX 3060 12G

WSL2,UBUNTU,openclaw,本機模型,vLLM

三、安裝Python 環境

更新系統: - sudo apt update

- sudo apt upgrade -y

安裝Python: - sudo apt install python3-pip python3-venv -y

建立虛擬環境: - cd ~

- python3 -m venv vllm-env

進入環境: - source vllm-env/bin/activate

四、安裝vLLM

安裝命令:

- pip install --upgrade pip

- pip install vllm

安裝完成後測試: - python -c "import vllm; print('vLLM installed')"

五、下載模型

推薦模型: - Qwen2. 5 -7B-Instruct-AWQ

模型優點: 啟動vLLM時會自動下載模型。

顯存提示 本教學示範使用的是12GB 顯示卡。如果你的顯存較小,建議選擇參數規模較小的模型,否則在載入模型時可能會出現:顯存不足(Out of Memory)的問題。 如果顯存不夠大,那麼可以選擇:Qwen2.5-4B-Instruct-AWQ 或比 Qwen2.5-4B 等較小的模型

運行命令: - python -m vllm.entrypoints.openai.api_server \

- --model Qwen/Qwen2.5-7B-Instruct-AWQ \

- --quantization awq_marlin \

- --gpu-memory-utilization 0.9 \

- --max-model-len 32768 \

- --enable-auto-tool-choice \

- --tool-call-parser hermes

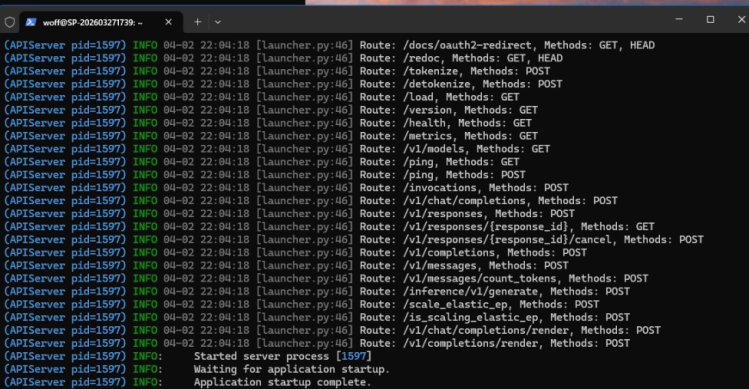

成功後會看到:

WSL2,UBUNTU,openclaw,本機模型,vLLM

說明API 已啟動成功。

說明API 已啟動成功。

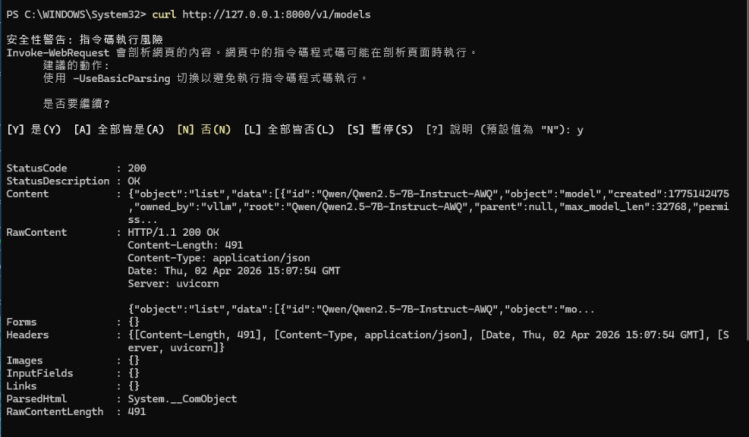

七、測試模型

在Windows PowerShell 測試: - curl http://127.0.0.1:8000/v1/models

返回模型資訊: Qwen/Qwen2.5-7B-Instruct-AWQ

說明連接正常。

WSL2,UBUNTU,openclaw,本機模型,vLLM

八、安裝OpenClaw在WSL 子系統裡執行安裝指令:

8.1 安裝Nodejs - curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash

- sudo apt install -y nodejs

使用nvm安裝不同版本的Node (包含npm)

更新相依套件

- apt-get update

- apt-get install build-essential libssl-dev

前往 https://github.com/nvm-sh/nvm/releases 確認目前nvm最新版本根據最新版本資訊 使用curl抓取指行語法 - curl https://raw.githubusercontent.com/creationix/nvm/v0.25.0/install.sh | bash

上面的版本請依照github看到的最新版本進行調整

使用下列指令,自動重開連線

驗證是否成功

安裝node + npm (nodejs 22 and npm 10最低需求) 使用下列語法取得目前遠端所有node版本

安裝目標版本

安裝完後 指定使用該版本的node

設定預設使用該版本的node 避免下次重啟後又恢復預設 檢查版本 - node -v # Verify it says v22.x.x

8.3 安裝openclaw - curl -fsSL https://openclaw.ai/install.sh | bash

8.4 安裝及設定 openclaw - sudo npm install -g openclaw@latest

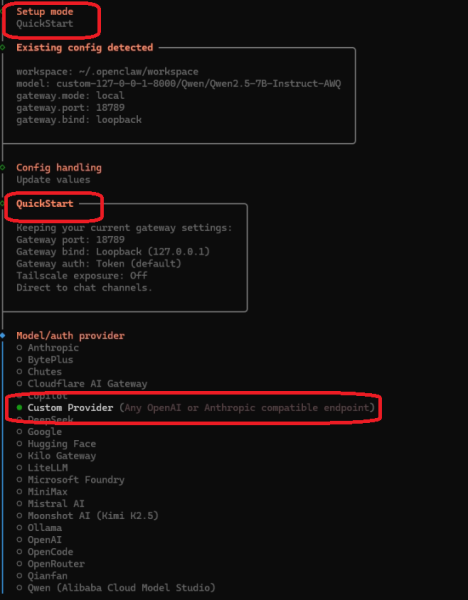

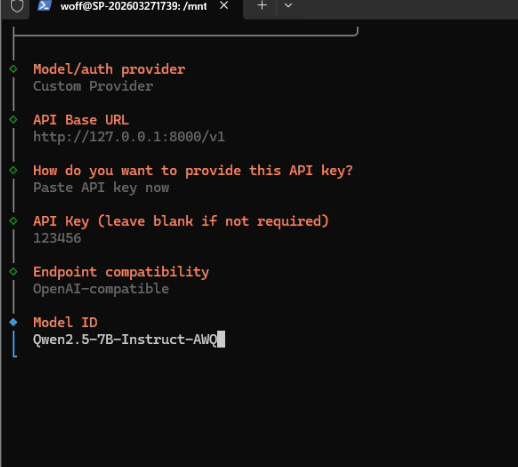

設定 provider模型 -> Custom Provider

WSL2,UBUNTU,openclaw,本機模型,vLLM

Base URL:http://127.0.0.1:8000/v1 API key: 123456 (隨便填寫) 模型名稱:Qwen2.5-7B-Instruct-AWQ 最後保存即可!

WSL2,UBUNTU,openclaw,本機模型,vLLM

十、OpenClaw 推薦參數(優化)為了避免卡頓: Context length: 6000–8000 Temperature:0.7 Max tokens: 2048

十一、優化推理速度(強烈建議)vLLM啟動參數建議: 注意:這是RTX3060顯示卡的配置,請根據你自己的顯示卡顯存來適當修改max-model-len 後面的參數 - python -m vllm.entrypoints.openai.api_server \

- --model Qwen/Qwen2.5-7B-Instruct-AWQ \

- --quantization awq_marlin \

- --gpu-memory-utilization 0.9 \

- --max-model-len 32768 \

- --enable-auto-tool-choice \

- --tool-call-parser hermes

效果: prefix cache加速prompt GPU利用率更高

十二、解決長對話卡頓在OpenClaw System Prompt加: When the conversation becomes long,

summarize previous messages into a short memory.

Keep the memory under 200 tokens. 這樣:

8000 token

↓

200 token memory

速度不會下降。 十三、最終性能參考(RTX3060)Qwen2.5-7B-Instruct-AWQ:

指標 | 數值 | | token生成速度 | 90– 130 token/ s | | 首token延遲 | 0.4 – 0.8秒 | | 最大情境 | 32K tokens(建議實際用8K– 16K) | | 顯存佔用 | 10– 12GB |

本地模型跑Openclaw 就完全夠用。

參考文章 https://www.freedidi.com/23445.html https://bmhiamso1.medium.com/ubuntu-%E5%AE%89%E8%A3%9D-nvm-npm-3bf6bffa9152 https://www.youtube.com/watch?v=rHmdJjOytRk

|